로컬LLM 미니PC 하나로 나만의 AI 비서를 24시간 운영할 수 있다면 어떨까요? 2026년 현재 오픈클로(OpenClaw), 나노클로(NanoClaw), 제로클로(ZeroClaw), 피코클로(PicoClaw) 같은 경량 AI 에이전트 도구들이 빠르게 확산되면서, 어떤 PC에서 어떤 도구를 써야 하는가라는 질문이 뜨거워지고 있습니다. 이 글에서는 각 도구의 특징과 차이를 명확하게 비교하고, 44만원대 입문 로컬LLM 미니PC부터 359만원 맥스튜디오까지 예산별 최적 선택지를 안내합니다.

1. 지금 왜 로컬 AI 에이전트인가? 클라우드 의존에서 벗어나기

AI 에이전트 소프트웨어 시장은 2025년 약 15억 달러 규모에서 2030년에는 418억 달러까지 성장할 것으로 예측됩니다. 연평균 성장률 175%라는 수치는 단순한 트렌드가 아니라, 업무 방식 자체가 바뀌고 있다는 신호입니다. 2026년 초 Anthropic이 Claude Agent SDK를 Xcode에 네이티브로 통합한다고 발표한 것도 같은 흐름 위에 있습니다.

그런데 보통 AI 도구들은 클라우드에 의존합니다. ChatGPT나 Claude를 웹에서 쓸 때마다 구독료가 나가고, 인터넷이 끊기면 작동이 멈추고, 내 데이터가 외부 서버로 전송됩니다. 개인 일정이나 업무 파일을 AI에게 맡기는 것이 꺼림칙한 이유가 바로 여기 있습니다.

로컬 AI 에이전트는 이 문제를 다르게 접근합니다. 내 PC에서 직접 실행되기 때문에 데이터가 밖으로 나가지 않고, 구독 없이 24시간 돌릴 수 있으며, 전력 소비가 낮은 로컬LLM 미니PC 한 대면 충분합니다. 특히 오픈소스 커뮤니티에서 빠르게 성장 중인 OpenClaw 계열 도구들은 WhatsApp이나 Telegram으로 AI 비서와 대화하듯 명령을 내리고, 이메일 읽기나 일정 관리 같은 반복 업무를 자동화할 수 있게 해줍니다.

이 글을 다 읽고 나면, 내 예산과 목적에 맞는 로컬 AI 환경을 어떻게 구축할지 명확한 그림이 그려질 겁니다.

2. 오픈클로 패밀리 4종 완벽 비교: 나노클로, 제로클로, 피코클로 차이점

OpenClaw가 오픈소스로 공개되면서 커뮤니티에서 파생된 도구들이 폭발적으로 등장했습니다. NanoClaw, ZeroClaw, PicoClaw, NanoBot, NullClaw, TinyClaw... 며칠 간격으로 새 버전이 나올 정도로 빠른 속도입니다. 공통점이 하나 있다면 WhatsApp이나 Telegram으로 AI 비서와 대화한다는 기본 철학인데, 그 위에서 각 도구가 선택한 방향은 꽤 다릅니다.

이 중에서 실제 활용 가능성이 높은 4종, 즉 오픈클로, 나노클로, 제로클로, 피코클로를 중심으로 살펴보겠습니다.

2-1. 오픈클로(OpenClaw): 기능 최강, 무거운 원조

OpenClaw는 이 모든 파생 도구의 출발점입니다. WhatsApp, Telegram, Slack, Discord, iMessage, Signal, Teams 등 15개 이상의 채널을 지원하고, 음성 기능과 실시간 캔버스, macOS/iOS/Android 컴패니언 앱까지 갖추고 있습니다. GitHub 스타가 8,000개를 넘을 정도로 커뮤니티에서 검증된 도구입니다.

단점은 무겁다는 것입니다. 실측 RAM 사용량이 1.52GB에 달하고, 의존성 패키지가 45개 이상입니다. 샌드박스 없이 시스템에 직접 접근하는 구조라 보안 측면에서 신경을 써야 합니다. 시스코 보고서에 따르면 에이전트 기술의 26%가 취약점을 보유하고 있는데, OpenClaw는 많은 기능을 기본 지원하는 만큼 공격 표면이 넓습니다.

추천 대상: 다채널 지원과 풍부한 기능을 원하고, macOS 컴패니언 앱까지 활용하고 싶은 파워 유저.

2-2. 나노클로(NanoClaw): 보안 특화, 500줄의 미학

나노클로는 코드 전체가 약 500줄입니다. OpenClaw가 수만 줄인 것과 비교하면 믿기 어려운 숫자지만, 이 단순함이 오히려 핵심 강점입니다. 코드가 작고 단순하니 에이전트 자신도, 사람도 코드베이스를 쉽게 이해할 수 있습니다. 원하는 기능이 없다면 "이 기능을 추가해 줘"라고 요청하면 에이전트가 직접 코드를 작성하고 추가합니다. 실제로 Unsplash에서 이미지를 가져오는 기능을 요청으로 추가한 사례가 시연된 바 있습니다.

보안 구조도 차별화되어 있습니다. Apple 컨테이너스(Containers) 샌드박스를 활용해 에이전트 실행을 격리시키고, 기본 채널이 WhatsApp 하나뿐이라 공격 표면 자체가 작습니다. "내 나노클로와 다른 사람의 나노클로는 완전히 다를 것"이라는 말이 나오는 이유입니다. 코드베이스 자체가 사용자 맞춤으로 진화하는 구조입니다.

설치에는 Node.js 20 이상, Docker, Claude Code가 필요합니다. Claude 구독 또는 Anthropic API 키도 필수인데, Claude Agent SDK가 기본적으로 Claude 모델만 지원하기 때문입니다. API 비용으로 토큰을 낭비하지 않으려면 구독이 더 효율적입니다.

추천 대상: 보안을 중시하고 Claude 구독을 사용 중이며, 나만의 맞춤 AI 비서를 직접 키워나가고 싶은 사용자.

2-3. 제로클로(ZeroClaw): 5MB의 초경량 Rust 엔진

Harvard와 MIT 출신 개발자들이 만든 Rust 기반 AI 에이전트입니다. RAM 사용량이 5MB 미만이고 시작 시간이 10ms 이하라는 수치가 눈길을 끕니다. OpenClaw와 비교하면 약 194배 이상 효율적입니다. "오픈클로는 샌드위치 사러 몬스터 트럭을 모는 것과 같고, 제로클로는 똑같이 빨리 도착하는 자전거"라는 비유가 딱 맞습니다.

모든 서브시스템(프로바이더, 채널, 도구, 메모리)이 교체 가능한 모듈 구조로 설계되어 있고, 하이브리드 벡터 검색과 Postgres SQL도 지원합니다. Telegram, Discord, WhatsApp 연동이 가능하고 OpenClaw에서 마이그레이션하는 도구도 내장되어 있습니다.

단, UI가 없습니다. 브라우저로 열 수 있는 대시보드가 아니라 API 엔드포인트만 제공합니다. 터미널에서 명령을 내리거나 메시지 앱으로 연결해야 합니다. 기술적인 배경이 없으면 처음 설정이 까다롭게 느껴질 수 있습니다. 또한 공개 VPS에 올리면 게이트웨이가 스크래핑될 위험이 있어 로컬 실행을 권장합니다.

추천 대상: 저사양 하드웨어에서 항상 켜져 있는 에이전트를 원하거나, 생산 환경에 배포할 기술 수준이 있는 사용자.

2-4. 피코클로(PicoClaw): 10달러짜리 하드웨어에서 돌아가는 Go 에이전트

피코클로의 계보를 따라가면 흥미롭습니다. OpenClaw(1GB 이상) → NanoBot(Python, 100MB) → PicoClaw(Go, 10MB 미만). 3세대를 거치며 리소스 사용량이 100분의 1 이하로 줄었습니다. Sipeed라는 하드웨어 회사가 자사 10달러짜리 보드에서 AI 에이전트를 돌리기 위해 만든 도구인데, 코어 코드의 95%를 AI 에이전트가 스스로 작성했다는 점이 독특합니다.

Go 단일 바이너리로 컴파일되기 때문에 x86과 ARM 아키텍처 모두에서 동작합니다. 라즈베리파이나 미니PC에서 그대로 쓸 수 있습니다. 무엇보다 Ollama 연동이 이 계열 도구들 중 가장 쉽습니다. config 파일에 Ollama 엔드포인트, 모델명, Telegram 봇 토큰만 설정하면 완전한 로컬 AI 환경이 완성됩니다. 인터넷 없이도 돌아가는 AI 비서를 원한다면 피코클로가 가장 현실적인 선택입니다.

추천 대상: 완전 로컬 AI를 원하거나, Ollama로 7B 모델을 돌리고 싶은 사용자. 저사양 기기에서도 가볍게 돌아가길 원한다면 첫 번째 선택입니다.

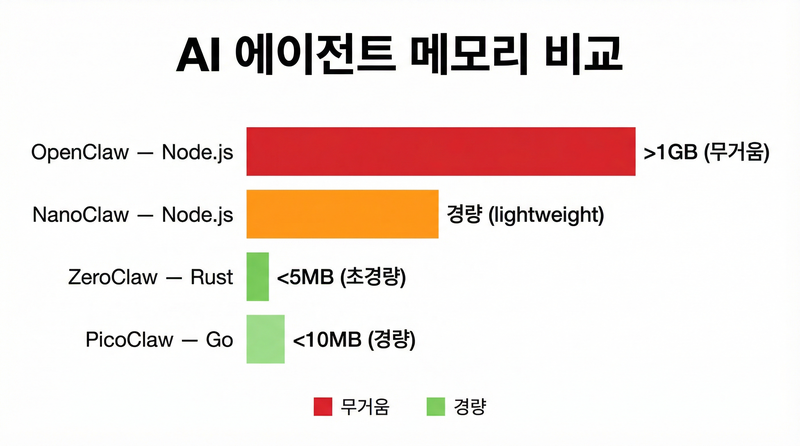

네 가지 도구의 핵심 차이를 한 눈에 비교하면 다음과 같습니다.

| 도구 | 언어 | RAM | 시작 시간 | 채널 | 로컬 LLM | 보안 | 추천 대상 |

|---|---|---|---|---|---|---|---|

| OpenClaw | Node.js | >1GB | 보통 | 15개+ | 외부 API | 기본 | 풀기능 파워유저 |

| NanoClaw | Node.js | 경량 | 보통 | 1개 (WhatsApp) | Claude 전용 | 높음 (Apple 컨테이너스) | 보안 중시 + Claude 구독자 |

| ZeroClaw | Rust | <5MB | <10ms | 3개 | 다중 모델 | 높음 | 기술자 / 생산 환경 |

| PicoClaw | Go | <10MB | <1초 | Telegram 중심 | Ollama 연동 | 중간 | 저사양 / 완전 로컬 |

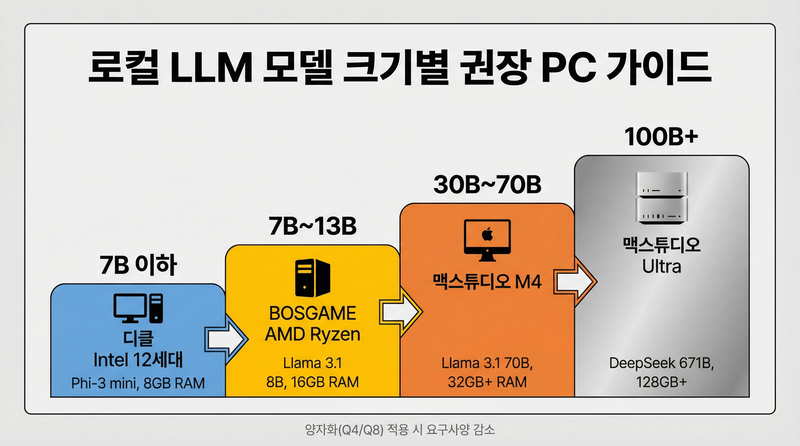

3. 로컬 LLM 실행의 핵심, 하드웨어 요구사양 이해하기

ZeroClaw나 NanoClaw는 외부 API(OpenRouter, Claude API)를 사용하므로 PC 성능과 무관하게 돌아갑니다. 하지만 PicoClaw처럼 Ollama로 로컬 LLM을 직접 실행하려면 이야기가 달라집니다. 모델 크기와 하드웨어 사양이 맞아야 합니다.

3-1. 모델 크기별 최소 RAM 가이드 (7B~70B)

| 모델 크기 | 권장 RAM | 권장 PC | 예시 모델 |

|---|---|---|---|

| 경량 (1B~3B) | 8GB | 디클 Intel 12세대 | Phi-3 mini, Qwen 1.5B |

| 소형 (7B) | 16GB | 디클 또는 BOSGAME | Llama 3.1 8B, Mistral 7B |

| 중형 (13B) | 16~32GB + GPU | BOSGAME AMD (확장 시) | Llama 2 13B |

| 대형 (30B~70B) | 32GB+ | Apple 맥스튜디오 M4 | Llama 3.1 70B, DeepSeek 67B |

| 초대형 (100B+) | 128GB+ | 맥스튜디오 Ultra | DeepSeek 671B (512GB 버전) |

참고로 양자화(Quantization)를 적용하면 로컬LLM 미니PC의 요구사양이 크게 줄어듭니다. 양자화란 모델의 수치 정밀도를 낮춰 크기를 압축하는 기술인데, Q4나 Q8 양자화를 적용하면 70B 모델도 더 낮은 RAM에서 돌아갈 수 있습니다. 속도와 품질이 약간 타협되는 부분은 있지만, 일반적인 대화나 업무 자동화에서는 차이를 체감하기 어렵습니다.

3-2. CPU vs 통합 메모리 — Apple Silicon이 특별한 이유

일반적인 PC는 CPU용 RAM과 GPU용 VRAM이 물리적으로 분리되어 있습니다. AI 모델 추론은 주로 GPU가 담당하는데, 일반 미니PC에 별도 GPU가 없다면 CPU로 처리해야 합니다. 속도가 느려지는 원인입니다.

Apple Silicon(M 시리즈 칩)은 다릅니다. CPU, GPU, Neural Engine이 하나의 메모리 풀을 공유하는 구조입니다. 즉, RAM이 그대로 VRAM 역할을 합니다. 맥스튜디오 M4의 통합 메모리 64GB는 그 자체로 64GB VRAM처럼 활용됩니다. 별도 GPU 없이 70B 파라미터 모델을 원활하게 실행할 수 있는 이유가 바로 이것입니다.

BOSGAME 미니PC의 AMD Ryzen 5 3550H도 Radeon Vega 8 내장 GPU를 포함하고 있습니다. 이 GPU 역시 시스템 RAM을 공유하는 방식이라 Ollama에서 VRAM으로 활용 가능합니다. 7B 모델 정도는 충분히 돌릴 수 있습니다. 다만 전용 VRAM이 없는 한계가 있어 13B 이상에서는 속도가 떨어집니다.

arXiv 논문 [2511.05502]에서 Apple Silicon 기반 로컬 AI 추론 성능을 비교한 결과, MLX 프레임워크(Apple Silicon 최적화 AI 런타임)가 지속적 토큰 생성 처리량에서 가장 높은 성능을 보였습니다. Ollama, llama.cpp, PyTorch MPS 대비 우위입니다. 맥스튜디오에서 로컬 LLM을 돌린다면 MLX 기반 모델을 선택하는 것이 좋습니다.

4. 예산별 미니PC 3종 추천: 입문, 중급, 프리미엄

도구도 골랐다면 다음은 로컬LLM 미니PC 선택입니다. 예산별로 딱 맞는 3가지를 정리했습니다. 어떤 AI 에이전트와 조합하면 가장 좋은지도 함께 안내합니다.

4-1. 입문용 (44만원대): 디클 2025 미니PC 인텔 12세대

디클 미니PC는 이름처럼 작고 단단합니다. 손바닥 크기의 본체에 USB-C, USB 3.0 포트 2개, 오디오 잭까지 갖춰 실용성을 놓치지 않았습니다.

인텔 12세대 N-시리즈 프로세서는 저전력 설계가 핵심입니다. 팬리스에 가까울 정도로 조용하고, 전력 효율이 높아 24시간 항상켜기에 부담이 없습니다. AI 에이전트 서버로 늘 켜두어도 전기세 걱정이 적습니다.

특히 놀라운 점은 이 작은 본체 하나로 모니터를 세 대까지 연결할 수 있다는 것입니다. AI 에이전트 대시보드, 코드 에디터, 채팅창을 각각 다른 화면에 띄워놓고 싶다면 이미 준비된 셋업입니다.

ZeroClaw(5MB만 필요)나 PicoClaw(초경량 Go 바이너리) 같은 도구는 이 PC에서 아무 문제 없이 돌아갑니다. 다만 Ollama로 30B 이상 대형 로컬 LLM을 돌리는 것은 무리입니다. 클라우드 API 기반 에이전트 서버로 쓰기에는 44만원대에서 이만한 선택이 없습니다.

디클 2025 미니PC 인텔 12세대

약 44만원대의 가격에 인텔 12세대 N-시리즈 저전력 프로세서를 탑재했습니다. 삼중 모니터 지원, 팬리스 조용한 동작, 24시간 상시 운영이 가능하며, ZeroClaw나 PicoClaw 같은 API 기반 에이전트에 최적화되어 있습니다. 다만 30B 이상의 로컬 LLM 실행은 무리가 있습니다.

디클 2025 미니 PC N-시리즈 인텔12세대 윈도우 포함 - 미니PC | 쿠팡

쿠팡에서 디클 2025 미니 PC N-시리즈 인텔12세대 윈도우 포함 구매하고 더 많은 혜택을 받으세요! 지금 할인중인 다른 미니PC 제품도 바로 쿠팡에서 확인할 수 있습니다.

www.coupang.com

4-2. 중급용 (44만원대): BOSGAME 미니PC AMD Ryzen 5

BOSGAME E4는 카본 패턴 디자인으로 첫눈에 '퍼포먼스 미니PC'임을 알 수 있습니다. 하지만 이 제품의 진짜 강점은 외관이 아닌 내부의 AMD Ryzen 5 3550H와 Radeon Vega 8 내장 GPU에 있습니다.

디클과 가격이 거의 같지만(할인가 449,000원) 성능 차이가 있습니다. Ryzen 5 3550H는 4코어/8스레드 구성으로 멀티태스킹에 강하고, Radeon Vega 8 내장 GPU는 시스템 RAM을 공유해 Ollama에서 GPU 추론이 가능합니다. 같은 44만원대에서 Ollama로 7B 모델을 GPU 가속으로 돌릴 수 있다는 것이 디클과의 핵심 차이입니다.

PicoClaw + Ollama 7B 조합은 이 PC에서 가장 검증된 경량 로컬 AI 환경입니다. Llama 3.1 8B나 Mistral 7B 같은 모델을 Telegram 봇으로 연결해 완전 로컬 AI 비서를 구축할 수 있습니다. 13B 이상 모델은 속도가 느려지므로 7B 범위에서 활용하는 것이 현실적입니다.

BOSGAME 미니PC E4 AMD Ryzen 5

약 45만원대의 할인가(정가 약 50만원대)로 AMD Ryzen 5 3550H와 Radeon Vega 8 내장 GPU를 제공합니다. GPU 가속 LLM 추론이 가능하며 카본 패턴 퍼포먼스 디자인으로 눈에 띕니다. PicoClaw + Ollama 7B 조합이 가장 검증된 사용 사례이며, 13B 이상 모델은 속도 저하를 감수해야 합니다.

BOSGAME 미니 PC E4 AMD Ryzen 5 3550H 미니 피씨 16GB DDR4 512GB SSD 듀얼 RJ45 LAN - 미니PC | 쿠팡

쿠팡에서 BOSGAME 미니 PC E4 AMD Ryzen 5 3550H 미니 피씨 16GB DDR4 512GB SSD 듀얼 RJ45 LAN 구매하고 더 많은 혜택을 받으세요! 지금 할인중인 다른 미니PC 제품도 바로 쿠팡에서 확인할 수 있습니다.

www.coupang.com

4-3. 프리미엄 (359만원): Apple 맥스튜디오 M4: RAM이 곧 VRAM

359만원이라는 가격표를 보면 잠깐 멈추게 됩니다. 그런데 맥스튜디오 M4의 가치는 외관의 미니멀한 알루미늄 바디 너머에 있습니다. 바로 'RAM이 곧 VRAM이 되는' Apple Silicon의 통합 메모리 구조입니다.

통합 메모리 최대 64GB를 갖춘 이 기기는 일반 PC의 64GB VRAM과 동급으로 작동합니다. Llama 3.1 70B, DeepSeek 67B 같은 대형 모델을 원활하게 돌릴 수 있는 미니PC는 현재 시장에서 맥스튜디오 M4가 사실상 유일합니다. 커뮤니티에서는 512GB 맥스튜디오(Ultra 모델)에서 DeepSeek 671B를 실행한 사례도 확인됩니다.

소비 전력이 40~80W 수준이라 24시간 항상켜기로 운용해도 전기비 부담이 적습니다. NanoClaw의 Apple 컨테이너스 샌드박스 보안 기능은 Mac 전용이라 맥스튜디오에서만 완전히 활용됩니다. arXiv 논문 기준으로 MLX 프레임워크가 로컬 AI 추론에서 가장 높은 처리량을 보이는 것도 이 조합의 이점입니다.

누구에게나 맞지 않습니다. 하지만 진지한 로컬 AI 환경을 원한다면, 타협 없는 선택지입니다.

Apple 2025 맥스튜디오 M4

약 359만원대의 프리미엄 가격에 Apple M4 칩(CPU + GPU + Neural Engine 통합 메모리)과 최대 64GB 통합 메모리를 제공합니다. RAM이 그대로 VRAM 역할을 하기 때문에 70B 모델 실행이 가능하며, NanoClaw의 보안 기능도 완전히 활용할 수 있습니다. MLX 프레임워크로 최고의 처리량을 경험할 수 있고, 40~80W의 저전력으로 24시간 상시 운영이 부담 없습니다. NanoClaw나 OpenClaw의 풀 기능을 원하는 사용자에게 최적화되어 있습니다.

Apple 2025 맥스튜디오 M4 - 미니PC | 쿠팡

쿠팡에서 Apple 2025 맥스튜디오 M4 구매하고 더 많은 혜택을 받으세요! 지금 할인중인 다른 미니PC 제품도 바로 쿠팡에서 확인할 수 있습니다.

www.coupang.com

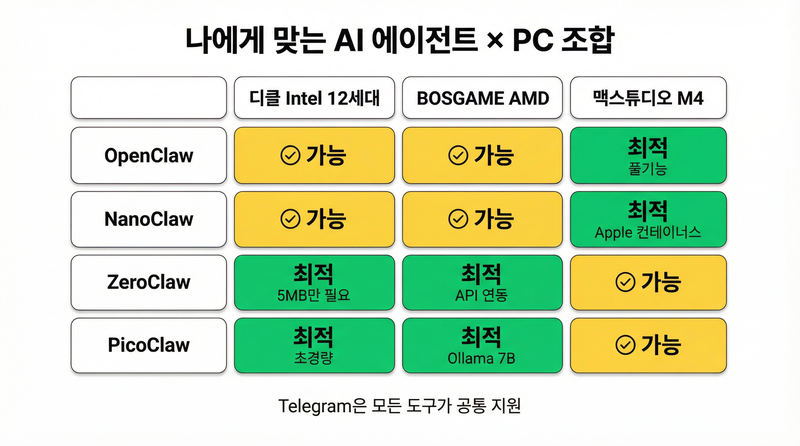

5. 도구별 x PC별 궁합 조합 가이드: 나에게 맞는 선택은?

4개 도구와 3개 PC의 조합을 한눈에 정리하면 다음과 같습니다. Telegram은 모든 도구가 공통으로 지원하는 유일한 채널이라는 점도 기억해두세요.

| 도구 | 디클 Intel 12세대 | BOSGAME AMD Ryzen | 맥스튜디오 M4 |

|---|---|---|---|

| OpenClaw | 가능 (API) | 가능 (API) | 최적 |

| NanoClaw | 가능 (API) | 가능 | 최적 (Apple 컨테이너스 전용) |

| ZeroClaw | 최적 (5MB만 필요) | 최적 (API 연동) | 가능 |

| PicoClaw | 최적 (초경량) | 최적 (Ollama 7B 연동) | 가능 |

| 로컬 LLM 규모 | 7B 이하 (양자화 시) | 7B (Ollama) | 70B+ 가능 |

시나리오별로 추천 조합을 정리하면 세 가지로 압축됩니다.

보안 중시 + 풀 기능 원함 + 예산 여유: 나노클로 + 맥스튜디오 M4. Apple 컨테이너스 샌드박스를 완전 활용하면서 대형 모델도 로컬에서 돌릴 수 있는 유일한 조합입니다.

가성비로 로컬 AI 시작: 피코클로 + BOSGAME AMD. Ollama 7B 모델을 GPU 가속으로 돌리고, Telegram 봇으로 어디서나 접근할 수 있습니다. 449,000원에 완전 로컬 AI 환경 구축이 가능한 최고의 입문 조합입니다.

서버 환경, 최소 리소스, 항상켜기: 제로클로 + 디클 인텔 12세대. 5MB짜리 에이전트가 저전력 팬리스 PC에서 24시간 돌아갑니다. 전기세와 소음 모두 신경 쓰지 않아도 됩니다.

위 표를 참고해 본인의 시나리오에 가장 가까운 조합을 선택해 보세요. 어떤 조합을 고르든 Telegram은 첫 번째 연결 채널로 추천합니다. 모든 도구에서 공통으로 지원하는 유일한 채널이기 때문입니다.

6. 자주 묻는 질문 (FAQ)

Q. 로컬LLM을 완전히 인터넷 없이 실행할 수 있나요?

PicoClaw + Ollama 조합은 초기 모델 다운로드 이후 완전 오프라인 실행이 가능합니다. 단, NanoClaw는 Claude API를 사용하기 때문에 인터넷 연결이 필수입니다. ZeroClaw도 OpenRouter API를 사용하므로 완전 오프라인은 어렵습니다.

Q. 나노클로는 Claude 구독이 꼭 필요한가요?

Claude 구독이나 Anthropic API 키 중 하나가 필요합니다. Claude Agent SDK가 기본적으로 Claude 모델만 지원하기 때문입니다. API 키로 사용하면 토큰당 비용이 발생하므로, 자주 쓸 예정이라면 구독이 더 효율적입니다.

Q. 윈도우 미니PC에서도 이 AI 에이전트들을 쓸 수 있나요?

ZeroClaw와 PicoClaw는 크로스 플랫폼을 지원해 Windows에서도 동작합니다. 다만 NanoClaw의 Apple 컨테이너스 보안 기능은 Mac 전용으로 Windows에서는 사용할 수 없습니다. OpenClaw는 Windows에서도 동작하지만 macOS 컴패니언 앱은 Mac에서만 이용 가능합니다.

Q. 로컬 LLM 실행에 GPU가 반드시 필요한가요?

ZeroClaw나 NanoClaw처럼 클라우드 API를 사용하는 도구는 GPU와 무관합니다. Ollama로 7B 모델을 직접 돌릴 경우 BOSGAME의 Vega 8 내장 GPU가 속도 향상에 도움이 됩니다. CPU만으로도 실행은 가능하지만 응답 속도가 느려집니다.

Q. 맥스튜디오 M4의 '통합 메모리 = VRAM'이란 무슨 뜻인가요?

일반 PC는 CPU용 RAM과 GPU용 VRAM이 물리적으로 분리되어 있습니다. Apple Silicon은 CPU, GPU, Neural Engine이 하나의 메모리 풀을 공유하기 때문에 64GB RAM이 그대로 64GB VRAM처럼 사용됩니다. 덕분에 별도 그래픽 카드 없이도 70B 파라미터 대형 모델을 원활하게 실행할 수 있습니다.

'정보 > AI' 카테고리의 다른 글

| 클로드코드 리모트컨트롤 기능 5분 완벽 가이드 (0) | 2026.02.26 |

|---|---|

| AI 코딩 에이전트 성능, CLAUDE.md가 오히려 독이 될 수 있다 (0) | 2026.02.25 |

| 클로드코드, 보리스 체르니가 말한 미래 개발의 정체 (0) | 2026.02.23 |

| AI 잘 쓰는 사람은 이것을 합니다 (프롬프트→컨텍스트 설계) (0) | 2026.02.22 |

| 바이브 코딩 망하고 싶지 않다면? DDD 필수 가이드 (0) | 2026.02.22 |